Künstliche Intelligenz hat die Softwareentwicklung in eine neue Dimension katapultiert. Was früher strukturiert geplant, entwickelt und getestet wurde, entsteht heute in Sekunden. Ein einzelner Prompt reicht aus, um vollständige Codebausteine, Automatisierungen oder sogar ganze Anwendungen zu generieren. KI schreibt nicht nur Code – sie skaliert Entwicklung in einer Geschwindigkeit, die klassische IT-Prozesse überholt.

Dabei ist die Leistungsfähigkeit längst nicht mehr auf einfache Skripte beschränkt. Moderne KI-Systeme erzeugen komplexe APIs, integrieren Datenbanken, bauen Frontends und automatisieren komplette Workflows. In vielen Fällen entstehen mehrere hundert oder sogar tausend Codezeilen pro Minute – und das iterativ, anpassbar und nahezu in Echtzeit.

Doch genau diese Geschwindigkeit bringt eine neue Herausforderung mit sich: Während Entwicklung exponentiell schneller wird, bleibt die Kontrolle oft linear oder stagniert sogar. Systeme entstehen schneller, als sie dokumentiert, geprüft oder verstanden werden können. Die eigentliche Frage ist daher nicht mehr, ob KI eingesetzt wird – sondern ob Unternehmen überhaupt noch nachvollziehen können, was gebaut wurde, wo es läuft und welche Risiken damit verbunden sind.

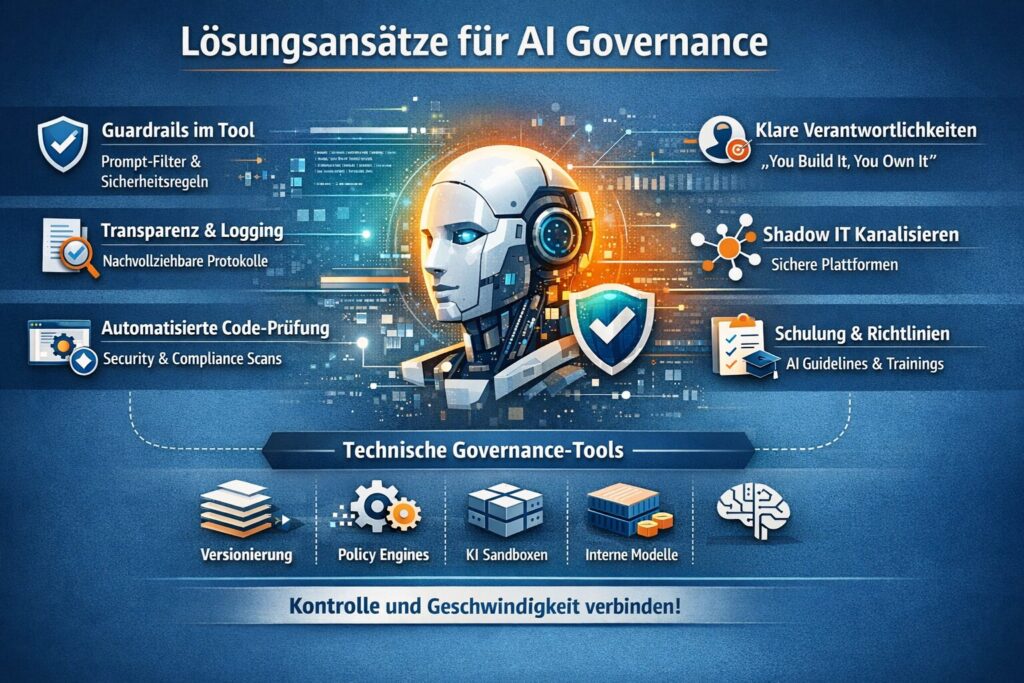

Und genau hier beginnt die Rolle von Governance – nicht als Bremse, sondern als notwendige Voraussetzung, um diese neue Geschwindigkeit überhaupt beherrschbar zu machen.Konkrete Lösungsansätze für AI Governance

Damit Governance in einer KI-getriebenen Welt funktioniert, muss sie direkt in die Nutzung integriert werden – technisch, organisatorisch und kulturell. Entscheidend ist: Kontrolle darf nicht nachgelagert passieren, sondern muss im Moment der Entstehung wirken.

Lesetipp: KI und Governance

1. Governance direkt im Tool verankern (Guardrails)

Der wirksamste Ansatz ist, Governance nicht als externen, nachgelagerten Prozess zu denken, sondern direkt in die KI-Tools und Entwicklungsumgebungen zu integrieren. In der klassischen IT wurde Kontrolle häufig über Freigaben, Reviews und Dokumentation sichergestellt – also über Schritte, die zeitlich nach der Entwicklung lagen. In der KI-Welt funktioniert dieses Modell nicht mehr, weil die Entwicklung selbst nahezu in Echtzeit stattfindet.

Wenn ein Nutzer innerhalb von Sekunden produktionsnahen Code erzeugen kann, muss Governance genau in diesem Moment greifen. Das bedeutet: Die Leitplanken müssen Teil des Tools sein, nicht Teil eines späteren Prozesses. Nutzer arbeiten weiterhin schnell und flexibel – aber innerhalb definierter Grenzen, die automatisch durchgesetzt werden.

Konkret bedeutet das:

- Prompt-Filter verhindern, dass sensible Daten (z. B. personenbezogene Informationen, Zugangsdaten oder interne Geschäftslogik) überhaupt in die KI eingegeben werden

- Prompts können automatisch angereichert werden, etwa durch Security- oder Compliance-Hinweise („Achte auf sichere Authentifizierung“, „Keine Verarbeitung personenbezogener Daten ohne Rechtsgrundlage“)

- Unsichere Libraries, Funktionen oder Muster werden direkt blockiert oder ersetzt

- Sichere Coding-Patterns werden aktiv vorgeschlagen oder erzwungen

Darüber hinaus können KI-Systeme selbst als Kontrollinstanz genutzt werden. Beispielsweise kann jeder generierte Code automatisch gegen interne Richtlinien geprüft werden, bevor er dem Nutzer überhaupt angezeigt oder zur Weiterverwendung freigegeben wird. Auch eine Klassifizierung nach Risikostufen (z. B. „unbedenklich“, „prüfpflichtig“, „kritisch“) ist denkbar und lässt sich direkt in den Workflow integrieren.

Ein weiterer wichtiger Punkt ist die Standardisierung von Entwicklungsumgebungen. Wenn KI-Nutzung nur in definierten, kontrollierten Tools erlaubt ist (z. B. Unternehmens-Copilots oder interne Plattformen), lassen sich diese Guardrails zentral steuern und kontinuierlich verbessern. Freie, unkontrollierte Nutzung externer Tools hingegen entzieht sich dieser Steuerung vollständig.

Das Ergebnis ist eine Form von „unsichtbarer Governance“: Sie bremst den Nutzer nicht durch Prozesse, sondern lenkt ihn durch integrierte Mechanismen. Genau das ist entscheidend, um Geschwindigkeit und Kontrolle gleichzeitig zu ermöglichen.

2. Transparenz und vollständige Nachvollziehbarkeit schaffen

Ohne Transparenz gibt es keine wirksame Governance. In einer Welt, in der Code und Lösungen in Sekunden entstehen, ist es essenziell zu wissen, wo KI eingesetzt wird, was genau erzeugt wurde und wer dafür verantwortlich ist. Ohne diese Nachvollziehbarkeit entsteht schnell ein Zustand, in dem Systeme existieren, die niemand vollständig versteht oder überblickt.

Transparenz bedeutet dabei mehr als reine Dokumentation. Sie muss automatisiert, vollständig und jederzeit abrufbar sein. Ziel ist eine lückenlose Auditierbarkeit aller KI-basierten Aktivitäten – sowohl technisch als auch organisatorisch.

Das umfasst insbesondere:

- Logging aller KI-Interaktionen, inklusive Nutzer, verwendetem Tool, Zeitpunkt und Zweck

- Speicherung der erzeugten Artefakte (z. B. Code, Skripte, Konfigurationen, Modelle) in nachvollziehbaren Strukturen

- Verknüpfung mit Identitäten (z. B. über SSO), sodass jede Aktivität eindeutig einem Verantwortlichen zugeordnet werden kann

Darüber hinaus sollte auch der Kontext erfasst werden, in dem KI genutzt wurde. Das bedeutet: Welche Prompts wurden verwendet? Welche Version des Modells kam zum Einsatz? Wurde der generierte Code verändert oder direkt übernommen? Diese Informationen sind entscheidend, um später nachvollziehen zu können, wie ein Ergebnis entstanden ist.

Ein praktischer Ansatz ist die zentrale Sammlung und Auswertung dieser Daten in Form eines „AI Activity Logs“ oder Dashboards. Unternehmen können so jederzeit sehen:

- Welche Bereiche KI intensiv nutzen

- Wo besonders viele Artefakte entstehen

- Welche potenziellen Risiken oder Auffälligkeiten existieren

Diese Transparenz ist nicht nur für interne Steuerung wichtig, sondern auch für externe Anforderungen. Regulatorische Vorgaben wie DSGVO oder der AI Act verlangen zunehmend, dass Entscheidungen und Prozesse nachvollziehbar sind. Ohne entsprechende Logging- und Tracking-Mechanismen lassen sich diese Anforderungen kaum erfüllen.

Am Ende gilt: Governance ohne Transparenz ist reine Theorie. Erst durch vollständige Nachvollziehbarkeit wird aus Kontrolle ein tatsächlich wirksames Steuerungsinstrument.Ziel ist eine vollständige Auditierbarkeit: Jede Entscheidung und jedes Ergebnis muss rekonstruierbar sein.

3. Automatisierte Qualitätssicherung etablieren

Manuelle Reviews waren lange Zeit ein zentraler Bestandteil der Qualitätssicherung in der Softwareentwicklung. In einer Welt, in der Code schrittweise entsteht und überschaubare Mengen produziert werden, funktioniert dieses Modell gut. In der KI-getriebenen Entwicklung stößt es jedoch an seine Grenzen. Wenn innerhalb von Minuten große Mengen an Code generiert werden, ist es weder realistisch noch effizient, jeden einzelnen Baustein manuell zu prüfen.

Deshalb muss Qualitätssicherung automatisiert, skalierbar und verpflichtend sein. Der entscheidende Unterschied liegt darin, dass Prüfungen nicht mehr optional oder nachgelagert sind, sondern integraler Bestandteil des Entwicklungsprozesses werden. Jeder erzeugte Code durchläuft automatisch definierte Prüfmechanismen – ohne Ausnahme.

Dabei geht es nicht nur um klassische Codequalität, sondern um ein erweitertes Verständnis von „Qualität“, das Sicherheit, Compliance und Wartbarkeit gleichermaßen umfasst.

Wichtige Bausteine sind:

- Security-Scanning, um bekannte Schwachstellen, unsichere Funktionen oder potenzielle Angriffsvektoren frühzeitig zu erkennen

- Compliance-Checks, die sicherstellen, dass beispielsweise keine unzulässigen Datenquellen genutzt oder externe APIs regelwidrig eingebunden werden

- Code-Qualitätsanalysen, die Aspekte wie Komplexität, Lesbarkeit und Wartbarkeit bewerten

Ein entscheidender Erfolgsfaktor ist der Zeitpunkt dieser Prüfungen. Sie sollten nicht erst im Nachgang erfolgen, sondern direkt beim Erstellen, Speichern oder Committen des Codes ausgelöst werden. Im Idealfall erhält der Nutzer sofort Feedback – ähnlich wie bei modernen CI/CD-Pipelines, nur deutlich schneller und enger integriert.

Darüber hinaus können KI-gestützte Prüfmechanismen selbst eingesetzt werden, um generierten Code zu bewerten. Beispielsweise lassen sich automatisierte „Second Opinions“ einbauen, bei denen eine zweite KI den Code auf Schwachstellen oder Inkonsistenzen überprüft. Auch eine Risikobewertung in Echtzeit ist möglich, etwa durch Klassifizierung in niedrige, mittlere oder hohe Kritikalität.

Langfristig entsteht so ein System, in dem Qualität nicht mehr durch individuelle Sorgfalt sichergestellt wird, sondern durch systematische, automatisierte Kontrolle. Das ist der einzige Weg, um mit der Geschwindigkeit der KI Schritt zu halten, ohne die Stabilität und Sicherheit der Systeme zu gefährden.

4. Klare Verantwortlichkeiten definieren

Auch wenn KI Code erzeugt, bleibt die Verantwortung immer beim Unternehmen. Genau hier entsteht jedoch eine der größten Herausforderungen: Wenn plötzlich viele Menschen in der Lage sind, Software zu erstellen, verschwimmt die klassische Trennung zwischen Fachbereich und IT. Ohne klare Verantwortlichkeiten führt das schnell zu einem Zustand, in dem niemand mehr eindeutig zuständig ist.

Deshalb ist es essenziell, Ownership konsequent neu zu denken und fest zu verankern. Jedes Artefakt – egal ob Skript, Anwendung oder Automatisierung – muss einen klar definierten Verantwortlichen haben. Dieser ist nicht nur für die Erstellung zuständig, sondern auch für Betrieb, Wartung und mögliche Auswirkungen.

Bewährte Prinzipien sind:

- „You build it, you own it“ – erweitert auf KI-generierte Systeme

- Jeder generierte Code hat einen klar benannten Ansprechpartner

- Eine zentrale Governance-Instanz (z. B. AI Board oder Platform Team) definiert Standards und Rahmenbedingungen

Dabei reicht es nicht aus, Ownership formal zu definieren. Sie muss auch technisch unterstützt werden. Beispielsweise kann jeder Code automatisch mit Metadaten versehen werden, die den Ersteller, den Zeitpunkt und den Kontext dokumentieren. So wird Verantwortung nicht nur organisatorisch, sondern auch systemseitig nachvollziehbar.

Ein weiterer wichtiger Aspekt ist die Differenzierung von Rollen. Während Fachbereiche zunehmend selbst entwickeln, bleibt die IT verantwortlich für Plattformen, Standards und übergreifende Steuerung. Governance wird damit zu einem Zusammenspiel aus dezentraler Verantwortung und zentraler Leitplanke.

Ohne klare Ownership entsteht schnell ein unkontrollierbares System: Anwendungen existieren ohne Wartung, Risiken bleiben unadressiert und Probleme lassen sich nicht mehr eindeutig zuordnen. Genau deshalb ist Verantwortung einer der zentralen Pfeiler moderner AI Governance – nicht als bürokratische Pflicht, sondern als Voraussetzung für nachhaltige Kontrolle. Ohne klare Ownership entsteht schnell ein unkontrollierbares System.

5. Shadow IT gezielt kanalisieren statt verbieten

Shadow IT ist kein neues Phänomen – aber durch KI hat es eine völlig neue Dimension erreicht. Fachbereiche können heute ohne tiefes technisches Wissen eigenständig Tools bauen, Prozesse automatisieren oder Daten auswerten. Der klassische Ansatz, solche Aktivitäten zu verbieten, ist in der Praxis wirkungslos geworden.

Der entscheidende Perspektivwechsel: Shadow IT ist kein Problem, sondern ein Signal für Innovationsbedarf. Wenn Mitarbeiter anfangen, eigene Lösungen zu bauen, zeigt das, dass bestehende Systeme ihre Anforderungen nicht ausreichend erfüllen.

Statt zu blockieren, sollte Governance darauf abzielen, diese Dynamik zu kanalisieren.

Konkrete Ansätze:

- Aufbau zentraler Plattformen für KI-gestützte Entwicklung, die sichere und standardisierte Rahmenbedingungen bieten

- Einsatz von Low-Code/No-Code-Umgebungen mit integrierter Governance (z. B. Zugriffskontrollen, Logging, Freigabemechanismen)

- Klare Freigabeprozesse für Tools, sodass Nutzer wissen, was erlaubt ist – und was nicht

Ein wichtiger Erfolgsfaktor ist die Balance zwischen Freiheit und Kontrolle. Wenn Governance zu restriktiv ist, entstehen Umgehungslösungen. Wenn sie zu locker ist, entstehen Risiken.

Ein bewährtes Modell ist die Schaffung von „Safe Spaces“ für Innovation: kontrollierte Umgebungen, in denen Nutzer experimentieren können, ohne die Stabilität produktiver Systeme zu gefährden. Beispielsweise können Sandbox-Umgebungen bereitgestellt werden, in denen neue KI-Anwendungen getestet werden, bevor sie in den produktiven Betrieb übergehen.

Langfristig entsteht so ein System, in dem Innovation nicht unterdrückt, sondern bewusst gesteuert wird. Geschwindigkeit bleibt erhalten – aber innerhalb klar definierter Leitplanken.

6. Standards, Schulung und Bewusstsein aufbauen

Technologie allein löst keine Governance-Probleme. Selbst die besten Tools und Plattformen sind wirkungslos, wenn die Nutzer nicht verstehen, wie sie verantwortungsvoll eingesetzt werden.

Gerade bei KI ist das Risiko hoch, dass Anwender die Technologie nutzen, ohne ihre Grenzen zu kennen. Das führt zu typischen Problemen: unsaubere Datenverwendung, Sicherheitslücken, Fehlentscheidungen durch ungeprüfte Ergebnisse oder unbewusste Bias-Verstärkung.

Deshalb ist der Aufbau von Kompetenz und Bewusstsein ein zentraler Bestandteil jeder Governance-Strategie.

Wichtige Maßnahmen:

- Klare und praxisnahe AI Usage Guidelines, die konkrete Do’s und Don’ts definieren (keine abstrakten Richtlinien, sondern anwendungsbezogene Regeln)

- Kurze, verpflichtende Trainingsformate, die auf den Arbeitsalltag zugeschnitten sind

- Sensibilisierung für zentrale Risikofelder wie Datenschutz, IT-Sicherheit und Bias

Ein häufiger Fehler ist es, Schulungen als einmalige Maßnahme zu betrachten. In der Realität muss Lernen kontinuierlich stattfinden – insbesondere, weil sich KI-Technologien schnell weiterentwickeln.

Zusätzlich sollten Guidelines eng mit der tatsächlichen Nutzung verzahnt sein. Idealerweise werden sie direkt in Tools integriert, sodass Nutzer im Moment der Anwendung Hinweise oder Einschränkungen erhalten. Beispielsweise könnte ein System warnen, wenn sensible Daten eingegeben werden, oder alternative, sichere Vorgehensweisen vorschlagen.

Ziel ist es, Governance nicht als externe Kontrolle wahrzunehmen, sondern als integralen Bestandteil der täglichen Arbeit. Wenn Mitarbeiter verstehen, warum bestimmte Regeln existieren und wie sie ihnen helfen, bessere Ergebnisse zu erzielen, steigt die Akzeptanz signifikant.

Am Ende entscheidet nicht die Technologie über den Erfolg von AI Governance – sondern das Verhalten der Menschen, die sie nutzen.

7. Technische Erweiterungen für skalierbare Governance

Neben organisatorischen Maßnahmen und klaren Prozessen braucht es eine technische Fundierung, um Governance in einer KI-getriebenen Welt überhaupt skalierbar zu machen. Klassische Governance-Mechanismen stoßen hier schnell an ihre Grenzen, weil sie nicht für dynamisch generierte Artefakte wie Prompts, Modelle oder automatisch erzeugten Code ausgelegt sind.

Deshalb entstehen neue technische Konzepte, die Governance direkt in die Systemarchitektur integrieren.

Ein zentraler Baustein ist die Versionierung von Prompts und KI-Ergebnissen. Während in der klassischen Softwareentwicklung Code versioniert wird, muss in der KI-Welt auch der Input (Prompt) und der Output nachvollziehbar sein. Nur so lassen sich Ergebnisse reproduzieren, Fehler analysieren und Änderungen kontrolliert ausrollen.

Ebenso wichtig ist die Trennung von Entwicklungs-, Test- und Produktionsumgebungen für KI-generierte Artefakte. Was banal klingt, wird durch KI komplexer: Ein Prompt, der in der Testumgebung funktioniert, kann in der Produktion andere Ergebnisse liefern. Daher müssen auch KI-spezifische Komponenten sauber entlang von Umgebungen getrennt und validiert werden.

Ein weiterer Hebel ist der Einsatz interner, kontrollierter KI-Modelle. Statt ausschließlich auf externe APIs zu setzen, können Unternehmen eigene Modelle oder isolierte Instanzen nutzen, um Datenhoheit, Datenschutz und Performance besser zu kontrollieren. Gerade in sensiblen Bereichen ist das ein zentraler Governance-Faktor.

Besonders wirkungsvoll sind Policy Engines, die Regeln automatisiert durchsetzen. Diese fungieren als technische Kontrollinstanz und prüfen beispielsweise:

- ob sensible Daten verarbeitet werden

- ob ein bestimmtes Modell für den Anwendungsfall zugelassen ist

- ob definierte Qualitäts- oder Sicherheitsanforderungen eingehalten werden

Damit verschiebt sich Governance von einer manuellen Kontrollfunktion hin zu einer automatisierten, systemseitigen Durchsetzung.

Ergänzend können weitere technische Mechanismen integriert werden:

- Logging und Audit-Trails für alle KI-Interaktionen

- Zugriffskontrollen auf Modelle, Daten und Funktionen

- Monitoring von Nutzung und Anomalien (z. B. ungewöhnliche Prompt-Muster)

Das Ziel dieser Erweiterungen ist klar: Governance darf kein nachgelagerter Prozess sein, sondern muss integraler Bestandteil der Architektur werden. Erst wenn Regeln automatisch greifen, entsteht ein System, das sowohl skalierbar als auch kontrollierbar ist.

Fazit

Effektive AI Governance ist kein einzelnes Tool und kein isolierter Prozess. Sie entsteht aus dem Zusammenspiel von integrierten technischen Kontrollen, klaren Verantwortlichkeiten und einem bewussten Umgang mit KI im Unternehmen.

Der entscheidende Erfolgsfaktor ist dabei immer derselbe: Governance muss so gebaut sein, dass sie mit der Geschwindigkeit der KI mithalten kann – nicht gegen sie arbeitet.

Lesetipp: KI und Governance